देश की न्याय व्यवस्था में तकनीक के बढ़ते उपयोग के बीच एक गंभीर मामला सामने आया है। Supreme Court of India ने उस घटना पर स्वतः संज्ञान (suo motu cognisance) लिया है, जिसमें एक ट्रायल कोर्ट ने अपने आदेश में कथित तौर पर AI-Generated ‘Fake’ Verdicts का हवाला दिया।

यह मामला सिर्फ एक आदेश की त्रुटि भर नहीं है, बल्कि यह सवाल खड़ा करता है कि क्या बिना सत्यापन के Artificial Intelligence पर निर्भरता न्याय प्रक्रिया को प्रभावित कर सकती है?

क्या है पूरा मामला?

मीडिया रिपोर्ट्स के अनुसार, एक Trial Court ने अपने फैसले में जिन पूर्व निर्णयों (precedents) का उल्लेख किया, वे बाद में संदिग्ध पाए गए। जांच में सामने आया कि जिन ‘verdicts’ का हवाला दिया गया था, वे वास्तविक न्यायिक रिकॉर्ड में मौजूद ही नहीं थे।

प्रारंभिक आशंका यह जताई गई कि संबंधित आदेश तैयार करते समय AI Tool की मदद ली गई, जिसने ऐसे ‘Fake’ Judgements जेनरेट कर दिए जो असल में कभी दिए ही नहीं गए।

इस पर Supreme Court ने गंभीरता दिखाते हुए मामले पर स्वतः संज्ञान लिया।

Supreme Court का रुख क्यों अहम है?

भारत में न्यायिक मिसाल (judicial precedent) का बहुत महत्व होता है। निचली अदालतें उच्च न्यायालयों और Supreme Court के फैसलों के आधार पर निर्णय देती हैं।

अगर कोई अदालत ऐसे निर्णयों का हवाला दे, जो वास्तव में अस्तित्व में ही नहीं हैं, तो:

-

न्याय प्रक्रिया की विश्वसनीयता प्रभावित होती है

-

पक्षकारों के अधिकारों पर असर पड़ सकता है

-

न्यायिक प्रणाली की पारदर्शिता पर सवाल उठते हैं

इसीलिए Supreme Court ने इस मामले को सिर्फ तकनीकी गलती नहीं माना, बल्कि इसे न्यायिक अनुशासन से जुड़ा गंभीर विषय समझा।

AI-Generated Content और न्याय व्यवस्था

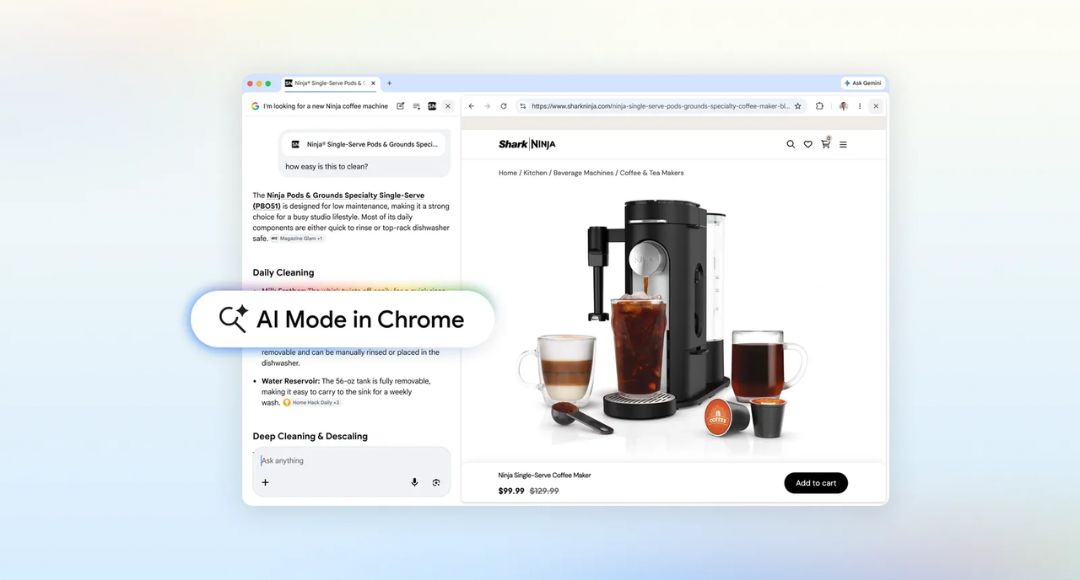

Artificial Intelligence का उपयोग आज हर क्षेत्र में हो रहा है, और न्यायपालिका भी इससे अछूती नहीं है। रिसर्च, केस लॉ खोजने और ड्राफ्ट तैयार करने में AI Tools मददगार हो सकते हैं।

लेकिन समस्या तब पैदा होती है जब:

-

AI द्वारा दी गई जानकारी को बिना सत्यापन स्वीकार कर लिया जाए

-

Generated Content को आधिकारिक स्रोत मान लिया जाए

-

फर्जी या अप्रमाणित निर्णयों को आदेश में शामिल कर लिया जाए

AI Tool डेटा के आधार पर टेक्स्ट तैयार करता है, लेकिन वह हमेशा वास्तविक और प्रमाणित न्यायिक रिकॉर्ड की गारंटी नहीं देता।

क्या हो सकते हैं कानूनी परिणाम?

अगर यह सिद्ध होता है कि किसी आदेश में Fake Verdicts का हवाला दिया गया, तो इसके कई प्रभाव हो सकते हैं:

-

संबंधित आदेश निरस्त किया जा सकता है।

-

मामले की दोबारा सुनवाई हो सकती है।

-

जिम्मेदारी तय करने के लिए प्रशासनिक जांच हो सकती है।

यह मामला भविष्य में AI के उपयोग के लिए दिशा-निर्देश तय करने की जरूरत को भी रेखांकित करता है।

न्यायपालिका में AI के उपयोग पर नई बहस

यह घटना एक बड़ी बहस को जन्म देती है क्या अदालतों में AI का उपयोग सीमित और नियंत्रित होना चाहिए?

विशेषज्ञों का मानना है कि:

-

AI को केवल सहायक उपकरण (assistive tool) के रूप में इस्तेमाल किया जाए

-

हर संदर्भ और केस लॉ को आधिकारिक डेटाबेस से क्रॉस-वेरिफाई किया जाए

-

न्यायिक अधिकारियों को डिजिटल साक्षरता और AI की सीमाओं पर प्रशिक्षण दिया जाए

तकनीक सुविधा देती है, लेकिन अंतिम जिम्मेदारी मानव न्यायाधीश की ही होती है।

न्याय प्रणाली की विश्वसनीयता सर्वोपरि

भारत की न्याय व्यवस्था की नींव निष्पक्षता और प्रमाणिकता पर टिकी है। Supreme Court द्वारा इस मामले पर त्वरित संज्ञान लेना यह संकेत देता है कि न्यायपालिका अपनी साख को लेकर सजग है।

यह कदम न केवल मौजूदा मामले के समाधान के लिए महत्वपूर्ण है, बल्कि भविष्य में AI-Generated Errors से बचाव के लिए भी मार्गदर्शक साबित हो सकता है।

Supreme Court द्वारा Trial Court के AI-Generated ‘Fake’ Verdicts पर संज्ञान लेना एक महत्वपूर्ण विकास है। यह घटना याद दिलाती है कि तकनीक कितनी भी उन्नत क्यों न हो, न्यायिक निर्णयों में मानवीय सतर्कता और सत्यापन अनिवार्य है।

आने वाले समय में संभव है कि न्यायपालिका AI के उपयोग को लेकर स्पष्ट गाइडलाइंस जारी करे, ताकि ऐसी घटनाओं की पुनरावृत्ति न हो और न्याय प्रणाली की विश्वसनीयता अक्षुण्ण बनी रहे।

Disclaimer: यह लेख उपलब्ध सार्वजनिक रिपोर्ट्स और कानूनी चर्चाओं के आधार पर तैयार किया गया है। मामले से संबंधित अंतिम तथ्य और आदेश आधिकारिक न्यायालयीय रिकॉर्ड के अनुसार ही मान्य होंगे।

Also read

IIT Kharagpur AI Course: जनरेटिव और एजेंटिक AI में नया ऑनलाइन सर्टिफिकेट प्रोग्राम लॉन्च